屑俺日記

僕の備忘録(PC、UN*X、ネットワーク関連が中心)なんです。

自分の書いたところは適当(な時とか)に書き換えますので御了承を。

2020-05-21(Thu) 爽やかな5月、も長くないだろうな

☆ SDDの有り難さ改めて

Intel Core i3-4130 CPUに4GB、240GB SDDを/に、320GB HDDを$HOMEにマウント

したハイブリッドなbuster。

dd(1) で /dev/urandom から1MBずつ読み込んだデータを1024回、

HDDとSDDとに書き出す。

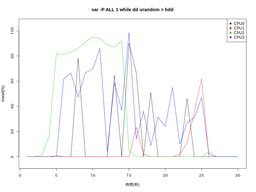

その間をsar(1)で測り、iowaitをグラフにしてみた。

手順は、

$ cat ddtest.sh #!/bin/sh LANG=C sar -P ALL 1 30 > /tmp/hdd_hdd & sleep 2 dd if=/dev/urandom of=1GB.img bs=1M count=1024 sync

のようなスクリプトを、lightdmを落としてリモートから実行。

HDDに書き出すと、

$ sh ddtest.sh 1024+0 レコード入力 1024+0 レコード出力 1073741824 bytes (1.1 GB, 1.0 GiB) copied, 23.0354 s, 46.6 MB/s

んで、sdd。

$ sh ddtest.sh 1024+0 レコード入力 1024+0 レコード出力 1073741824 bytes (1.1 GB, 1.0 GiB) copied, 4.7901 s, 224 MB/s

awkで切り出し、最終行(平均値統計)を落とす。これもスクリプトに しないと。

$ awk 'BEGIN{print "Time iowait";time=1}$2==0{print time, $6;time+=1}' \

> hdd_hdd |head -n31 >hdd_cpu0

基本的に同じRスクリプトでもってグラフにする。

HDDと

SDDの差が歴然。

適当に検索すると、iowaitではCPUに負荷がかかってるときには 分からなくなるからvmstat(8)やiostat(1)を使え、とかも。

[ツッコミを入れる]

リンクはご自由にどうぞ。でもURLや内容が変った場合はあしからず。